別再把 AI 當許願精靈:Palantir 的「實習生養成」部署哲學

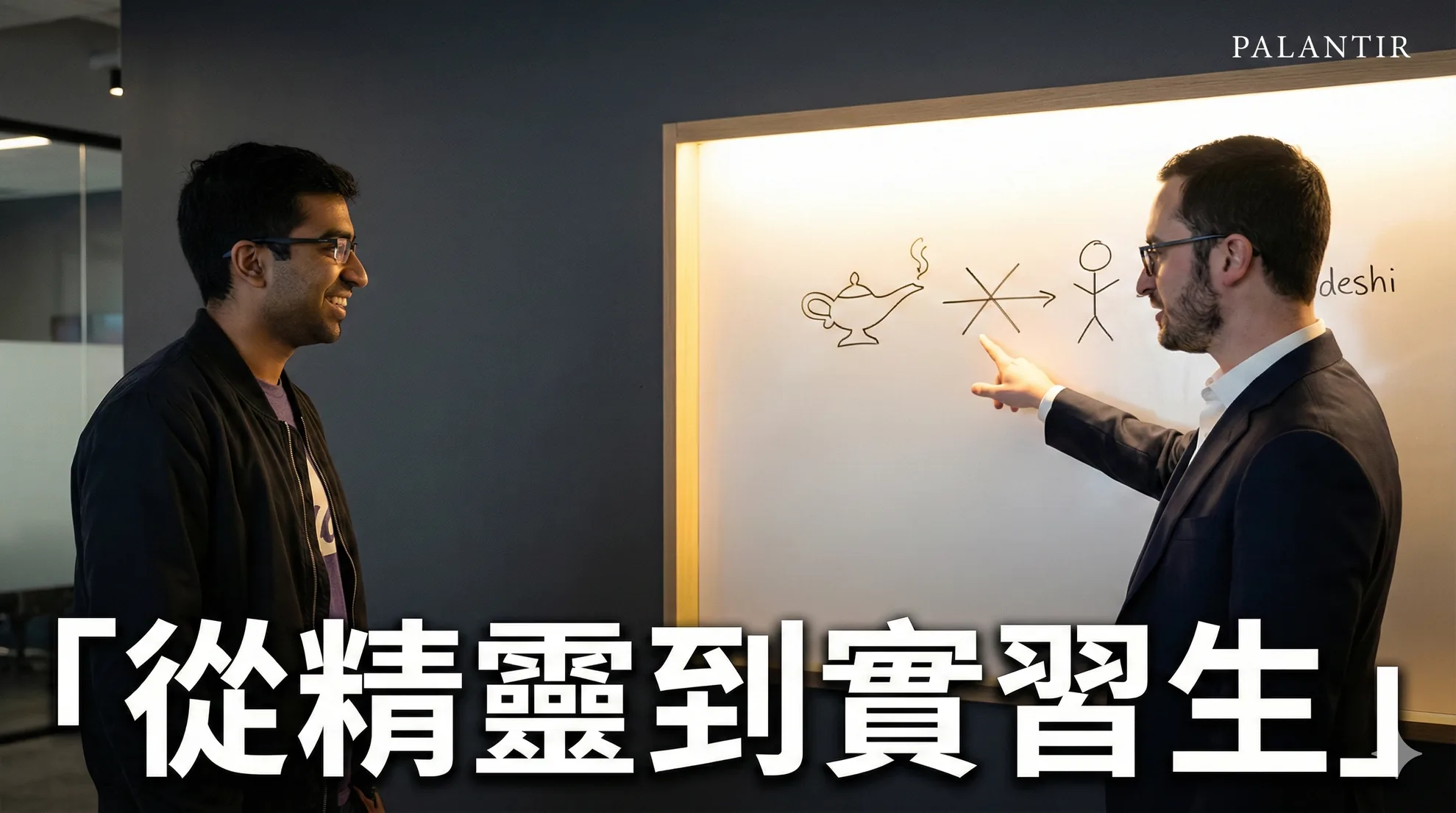

Palantir 首席架構師 Akshay Krishnaswamy 用一個日本客戶的比喻,說明企業 AI 部署為什麼不該是一次性的問答,而應該像帶一個聰明的實習生:先讓它理解你的工作脈絡,再逐步擴大它的職責範圍。

本文整理自 Palantir 官方頻道 2026 年 1 月發布的對談影片。

Palantir 有一個日本客戶,用了一個詞來形容他們心目中 AI 應該扮演的角色:「弟子」(deshi)。不是無所不能的神諭,不是按一下就出答案的自動販賣機,而是一個很聰明但什麼都還不懂的實習生。這個比喻精準地捕捉到一件多數企業在導入 AI 時搞錯的事。

「許願精靈」模式為什麼行不通

Palantir 首席架構師 Akshay Krishnaswamy 在與 Palantir 資深顧問 Jordan Hirsch 的最近一場對談中,用了一個很尖銳的比喻來描述當前多數企業使用 AI 的方式:許願精靈。你對著聊天框丟出一個問題,AI 給你一個答案,這個答案可能好可能壞,然後這段互動就結束了。下次你問它同樣類型的問題,它不會因為上次的經驗而變得更好,因為它根本不記得你,也不理解你的工作環境。

Krishnaswamy 把這稱為「I’m feeling lucky 按鈕」,就像早年 Google 搜尋頁面上那個「好手氣」按鈕一樣,你按下去就直接跳到一個結果,碰運氣看看它對不對。這種模式用來查天氣或翻譯一個單字沒什麼問題,但如果你的工作是管理一座電廠的負載平衡、排定一家醫院三百名護理師的輪班表、或是處理供應鏈中每天湧入的幾百個異常事件,靠一個「碰運氣按鈕」是不夠的。

問題的根源在於:聊天機器人的互動是短暫的、片段的,它跟你的實際工作流程之間沒有持續的連結。它不知道你昨天做了什麼決策、那個決策產生了什麼後果、你從中學到了什麼。每次對話都是從零開始。這表示 AI 永遠停在「第一天上班」的狀態,無法累積對你工作環境的理解。

決策的三個元素:資料、邏輯、行動

那什麼才是正確的做法?Krishnaswamy 從技術架構的角度提出了一個框架。他說,任何一個決策過程,不管多簡單或多複雜,都可以拆解成三個基本元素。

第一個是資料。你在做決策時會參考哪些資訊?可能是庫存水位、設備狀態、客戶歷史紀錄、氣象預報、同事的口頭回報。第二個是邏輯。你根據這些資訊,用什麼樣的判斷原則來評估可能的行動方案?這裡面有些是明文規定的標準作業程序,有些是你自己多年經驗累積出來的直覺判斷。第三個是行動。你最終做了什麼?是調整一個參數、批准一個申請、發出一封通知、還是啟動一套應急流程?

人類工作者每天都在反覆執行這個循環,很多時候是無意識的、自動化的。問題在於,大部分的 AI 部署只切入了其中一小塊。聊天機器人能幫你查資料,但它不理解你的判斷邏輯,也沒辦法幫你執行行動。它跟你的工作流程是脫節的。

Palantir 的做法是先建立他們所謂的「Ontology」系統,把企業的供應商、客戶、設備、工單、物流路線等核心元素,以及它們之間的關聯性,全部建模成一個統一的決策平面。AI 和人類工作者在同一個平面上運作,看同樣的資料、遵循同樣的邏輯、執行同樣的行動。這樣 AI 才有可能從「旁觀者」變成「同事」。

漸進式放手:從分揀開始,一步一步來

有了共同的決策平面之後,下一個問題是:AI 該從哪裡開始介入?Krishnaswamy 的答案是:從最不容易出錯、但最消耗時間的環節開始。

他以供應鏈管理為例。一個處理供應商問題的工作者,每天面對的第一件事就是分揀,從幾十個甚至幾百個待處理事項中,判斷哪些最緊急、哪些可以晚點處理、哪些需要升級。這個分揀工作本身不需要太深的專業判斷,但它極度耗時,而且如果分揀不準確,後面的所有決策都會受影響。

讓 AI 從這一步切入,風險相對可控。如果 AI 分揀錯了,人類工作者在下一步檢查時就會發現。但如果 AI 分揀得夠好,工作者省下的時間可以用在更需要專業判斷的後續環節。這就是 Krishnaswamy 說的「平滑地轉動旋鈕」。不是一口氣把所有決策都交給 AI,而是先讓它負責一個小環節,做好了再擴大範圍。

這跟帶實習生的邏輯完全一樣。你不會第一天就讓實習生做最關鍵的決策。你先讓他做一些輔助性的工作,觀察他的表現,修正他的錯誤,慢慢給他更多責任。而在這個過程中,實習生學到了你的工作方式、判斷標準和品質要求,他處理事情的方式會越來越接近你的期待。

AI 也一樣。當它在分揀環節上跟人類工作者反覆互動,學習到哪些分揀結果被接受、哪些被修改、修改的理由是什麼,它對這個工作環境的理解就會逐步深化。這種學習不是發生在模型的預訓練階段,而是發生在實際部署之後、在具體的業務場景中。

PG&E:一個「實習生養成」的實際案例

加州太平洋瓦斯與電力公司(PG&E)是北美最大的公用事業公司之一,服務北加州約 1600 萬人。近年來加州野火問題嚴峻,而老化的電網設備是潛在的起火源之一,PG&E 因此面臨極大的安全壓力。他們的應對策略之一是「公共安全斷電」(PSPS),在高風險時段主動切斷部分電網供電,防止電線走火引發山林大火。

但每一次斷電都是一個棘手的權衡問題。斷電影響居民和商業用戶的正常生活,過度斷電會引發民怨和經濟損失,斷電不足又可能釀成災難。過去這些決策主要靠電網操作員的經驗和判斷,而這些操作員對電網系統的理解之深,讓 Krishnaswamy 形容他們幾乎是電網本身的延伸。

PG&E 在 AIPCon(Palantir 的客戶大會)上分享了他們導入 Palantir AIP 和 Foundry 平台的經驗。他們沒有讓 AI 直接做斷電決策,而是讓 AI 幫助操作員在評估每一個斷電提案時,能同時考慮更多維度的資訊。氣象預報、線路老化數據、歷史事故模式、周邊植被狀態、用電戶的分布,這些資料過去散落在不同的系統裡,操作員只能憑經驗選擇性地參考一部分。現在 AI 能夠把這些資訊整合起來,在操作員做判斷的那個節點,提供更完整的情境。

結果是 PG&E 在導入系統後,顯著降低了野火前兆事件的發生頻率,同時也減少了不必要的大規模斷電。操作員的角色沒有被取代,他們的判斷能力反而因為有更好的資訊支援而得到提升。AI 從「什麼都不懂的新手」,逐步成長為能夠有效協助決策的「資深實習生」。

我的觀察:臺灣企業的 AI 部署還停在「第一天」

我觀察到臺灣企業在 AI 部署上有一個很普遍的模式:先花一筆預算導入某個 AI 解決方案,通常是聊天機器人或某種自動化工具,然後發現效果沒有想像中好,接著就開始質疑「AI 到底有沒有用」。

問題不在 AI 有沒有用,而在部署的方式。多數企業的 AI 部署停留在 Krishnaswamy 說的「許願精靈」階段,用戶跟 AI 之間的互動是片段的、斷裂的,AI 沒有機會理解工作者的實際流程,也沒有機制讓它從互動中學習。這等於是請了一個實習生來公司,但不讓他坐在你旁邊觀察你怎麼工作,只是偶爾丟一個問題給他,然後根據他回答的品質來決定要不要繼續用他。這樣的實習生當然不會進步。

Palantir 的方法論是否適用於所有企業?不一定。他們的平台導入門檻高、成本不低,而且需要相當程度的組織改造配合。但「實習生養成」這個思路本身值得借鏡。企業在導入 AI 時,與其追求一步到位的「全自動化」,不如先找到一個具體的、風險可控的環節讓 AI 切入,讓它跟第一線工作者一起工作,慢慢建立對業務場景的理解,再逐步擴大責任範圍。

這需要耐心,也需要企業願意把 AI 部署當作一個持續的養成過程,而不是一次性的採購決策。很多臺灣老闆問的第一個問題是「導入 AI 要花多少錢」,但更應該先問的是「我們準備好讓 AI 學什麼、跟誰學、從哪裡開始學了嗎」。答案如果是「還沒有」,那再好的模型買進來也只是一個昂貴的許願精靈。